বলবর্ধনমূলক শিখন

এই নিবন্ধটিতে এত বেশী কারিগরি পরিভাষা ব্যবহার করা হয়েছে যে হয়ত অধিকাংশ পাঠকের জন্য এটি বোঝা দুরূহ হতে পারে। |

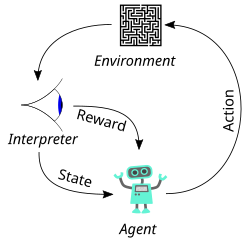

বলবর্ধনমূলক শিখন বা ইংরেজি পরিভাষায় রিইনফোর্সমেন্ট লার্নিং (আরএল) হল যন্ত্রীয় শিখন তথা মেশিন লার্নিংয়ের একটি শাখা, যেখানে কোনো পরিবেশে কোন পদক্ষেপ নেবার মাধ্যমে সেখানকার অবস্থার সর্বোত্তম উন্নতি করা হয়। বলবর্ধনমূলক শিক্ষাগ্রহণ হল তিন ধরনের মৌলিক যন্ত্রভিত্তিক শিক্ষাগ্রহণের একটি। অপর দুই ধরনের যন্ত্রনির্ভর শিক্ষাগ্রহণ হল তত্ত্বাবধানকৃত শিক্ষাগ্রহণ ও তত্ত্বাবধায়নহীন শিক্ষাগ্রহণ।

বলবর্ধনমূলক শিক্ষাগ্রহণ তত্ত্বাবধায়নকৃত শিক্ষাগ্রহণ থেকে আলাদা। কেননা সেখানে ইনপুট ও আউটপুটে পাওয়া বিষয় উপস্থাপনের দিকে জোর দেওয়া হয় না। এছাড়া সেখামে প্রায় আন্দাজকৃত বিষয়কে পুরোপুরিভাবে সঠিক হতে হয় না। অপরদিকে এখানে অনুসন্ধান (চার্টহীন এলাকা) ও ব্যবহারের (বর্তমান জ্ঞান) দিকে গুরুত্ব দেওয়া হয়।[১]

এই পরিবেশের গঠন প্রক্রিয়া সাধিত হয় মারকভ সিদ্ধান্ত প্রক্রিয়ার (এমডিপি) মাধ্যমে। অনেক বলবর্ধনমূলক শিখন অ্যালগরিদম ব্যবহার করে থাকে ডায়নামিক প্রোগ্রামিং পদ্ধতি।[২] প্রাচীন ডায়নামিক প্রোগ্রামিং পদ্ধতি ও বলবর্ধনমূলক শিখনের পার্থক্য হল বলবর্ধনমূলক শিখন এমডিপির মূল গাণিতিক মডেল ভিত্তি করে চলে না ও এটি চলে বৃহৎ এমডিপির ভিত্তিতে যেখানে আসল পদ্ধতি জানা সম্ভব নয়।

সূচনা[সম্পাদনা]

সাধারণত্বের জন্য বলবর্ধনমূলক শিখনে অন্যান্য শাখা যেমন, ক্রীড়াতত্ত্ব, নিয়ন্ত্রণ তত্ত্ব, ক্রিয়া গবেষণা, অনুকরণীয় আন্দাজক্তণ, অনেক প্রতিনিধি প্রক্রিয়া, দল বুদ্ধিমত্তা, পরিসংখ্যান ও জেনেটিক অ্যালগরিদম পড়ানো হয়। ক্রিয়া গবেষণা ও নিয়ন্ত্রণ তত্ত্বে বলবর্ধনমূলক শিখনকে "অনুমিত গতিশীল প্রোগ্রামিং" বা "নিউরো ডায়নামিক প্রোগ্রামিং" বলা হয়। বলবর্ধনমূলক শিখনের মূল বিষয়গুলো আনুমানিক নিয়ন্ত্রণ তত্ত্বেও আলোচনা করা হয়, যা অনুমিত বিষয়ের ফলাফল, আলোচনা ও গবেষণা, উৎপাদন ব্যবস্থা সংক্রান্ত অ্যালগরিদমের দিকে আলোকপাত করে থাকে, শিক্ষাগ্রহণ ও আন্দাজকরণের দিকে দেয় কম গুরুত্ব; মূলত এটি অর্থনীতি ও ক্রীড়াতত্ত্বের পরিবেশে গাণিতিক মডেলের অনুপস্থিতিতে কাজ করে থাকে। সীমাবদ্ধ প্রক্রিয়ায় কীভাবে সাম্যতা অর্জন সম্ভব সেটা ব্যাখ্যা করতেও বলবর্ধনমূলক শিখন ব্যবহার করা যেতে পারে।

মৌলিক বলবর্ধনমূলক শিখনকে মারকভ সিদ্ধান্ত প্রক্রিয়ার ভিত্তিতে সাজানো হয়েছে:

- একগুচ্ছ পরিবেশ ও প্রতিনিধির অবস্থা, S;

- প্রতিনিধির একগুচ্ছ ক্রিয়া A;

- এটি হল কোন অবস্থা , অন্য অবস্থা , কোনো ক্রিয়া এর মাধ্যমে রূপান্তরিত হবার পর পাওয়া সম্ভাবনা

- হল প্রাথমিক উপায়ন, যা থেকে এ ক্রিয়ায় মাধ্যমে পাওয়া যায়

- নীতিগুলো বর্ণনা করবে প্রতিনিধি তার দেখার ভিত্তিতে

এই নীতিগুলি সম্ভাবনার সূত্র দ্বারা নিয়ন্ত্রিত। এই পর্যবেক্ষণগুলো মূল স্কেলার, প্রাথমিক উপায়ন শেষ রূপান্তরের সাথে সম্পর্কযুক্ত। অজ্রক ক্ষেত্রে প্রতিনিধিকে বর্তমান পরিবেশের অবস্থা পর্যবেক্ষণ (পুরোপুরি পর্যবেক্ষণ) করতে দেওয়া হয়। যটি এটা না করা হয়, তবে প্রতিনিধির পর্যবেক্ষণ পুরোপুরিভাবে শুদ্ধ হবে না। কখনো কখনো ক্রিয়ার বিষয় পর্যবক্ষকের নিকট উপস্থাপন করা হয় না। (পুরোপুরিভাবে সাম্যতার ক্ষেত্রে কখনো ছাড় দেওয়া হয় না। উদাহরণস্বরূপ, প্রতিনিধির দেখা মান ৩ ও রূপান্তরিত অবস্থার মান ৪ হলে এই রূপান্তরকে গোণা হবে না।)

বলবর্ধনমূলক শিখন এজেন্ট বিচ্ছিন্ন সময়েএ পরিবেশ নিয়ে কাজ করে। প্রত্যেক t সময়ে, প্রতিনিধি পর্যবেক্ষণ করেন যাতে উপায়ন অন্তর্ভুক্ত করা হয়। এরপর এটি ক্রিয়া বাছাই করে সহজলভ্য ক্রিয়া থেকে, যাজে পরিবেশে পাঠানো হয়। এরপর, পরিবেশ নতুন অবস্থা ও উপায়ন এ গমন করে যার সাথে নির্ণয় করা "রূপান্তর" এর সম্পর্ক বিদ্যমান। বলবর্ধনমূলক শিখনের লক্ষ হল যতটা পারা যায় উপায়ন সংগ্রহ করা। প্রতিনিধি কোন প্রক্রিয়ায় (সম্ভবত দৈবচয়নে) পরিবেশে কোন সিদ্ধান্ত গ্রহণ করতে পারে।

যখন কোন প্রতিনিধির কাজকে অনুমানের ভিত্তিতে কাজ করা কোন প্রতিনিধির কাজের সাথে তুলনা করা হয়, তখন চোখে পড়ে ক্রীড়াতত্ত্বের "খেদ"। অনুমানের ভিত্তিতে কাজ করতে হলে প্রতিনিধিকে এর কাজের ধারা (সর্বোচ্চ ভবিষ্যৎ আয়) সম্পর্কে জ্ঞানলাভ করতে হবে, যদিও প্রাথমিক উপায়নের ক্ষেত্রে এ মান কাজে নাও আসতে পারে।

এভাবে, দীর্ঘমেয়াদী ও স্বল্পমেয়াদী কাজের ক্ষেত্রে সমস্যা সমাধানের জন্য বলবর্ধনমূলক শিখন কাজে আসতে পারে। এটি বিভিন্ন প্রক্রিয়া যেমন রোবট নিয়ন্ত্রণ, সিঁড়ি তালিকা, টেলিকমিউনিকেশন, ব্যাকগ্যামন, চেকার্স[৩] ও গোয়ের (আলফা গো) ক্ষেত্রে ব্যবহৃত হতে পারে।

দুইটি উপাদান বলবর্ধনমূলক শিখনকে শক্তিশালী করে তালে: অনুমান ফলাফলের মাধ্যমে নমুনার ব্যবহার ও বৃহৎ পরিবেশের ভিত্তিতে কোনো আন্দাজকৃর ফাংশনের ব্যবহার। এই দুইটি উপাদানকে ভিত্তি করে নিম্নোক্ত অবস্থার বৃহৎ পরিবেশে বলবর্ধনমূলক শিখন ব্যবহৃত হতে পারে:

- জানা পরিবেশের মডেল যেখানে বিশ্লেষণী সমাধান পাওয়া না;

- কেবল পরিবেশের অনুকারী মডেল বিদ্যমান (অনুকরণভিত্তিক আন্দাজকরণ);[৪]

- কোনো পরিবেশে সেটি সম্পর্কে জানার ক্ষেত্রে তথ্য সংগ্রহের একমাত্র মাধ্যম হিসেবে।

এই সমস্যার দুইটি পরিকল্পিত সমস্যা হিসেবে বিবেচিত কেননা, এখানে কিছু জিনিস পাওয়া যায়। অপরদিকে শেষেরটি মূল শিক্ষাগ্রহণ সমস্যা হিসেবে পরিগণিত হয়। যাই হোক, রেইনফোর্সমেন্ট শিখন দুটো সমস্যাকে মেশিন শিখন সমস্যায় পরিণত করে।

অনুসন্ধান[সম্পাদনা]

অনুসন্ধান ও শোষণের সমস্যা বার্নেটাস ও কাটেহাকিস ১৯৯৭ সালে মাল্টি আর্মড ব্যান্ডিট সমস্যার মাধ্যমে নিয়ন্ত্রিত অবস্থার এমডিপিতে আলোচনা করেছেন।[৫]

বলবর্ধনমূলক শিখনে দৃঢ়তম শোষণ পদ্ধতি জানতে হয়। দৈবচয়িত ক্রিয়া আনুমানিক সম্ভাবক্না ছাড়া কাজ করলে তার ফলাফল ভালো হয় না। ছোট নির্দিষ্ট মারকভ সিদ্ধান্ত প্রক্রিয়া তুলনামূলকভাবে সহজে বোঝা যায় যাই হোক, অ্যালগরিদম কম থাকার কারণে বিভিন্ন পরিবেশের জন্য (অথবা বিভিন্ন সমস্তার অসীম অবস্থার জন্য) সরল শোষণ প্রক্রিয়া সবচেয়ে উপযোগী।

এই ধরনের পদ্ধতি হল -গ্রিডি, যেখানে হল এমন বিষয় যা অনুসন্ধান ও শোষণের পরিমাণ নিয়ন্ত্রণ করে। সম্ভাবনা , এর মাধ্যমে শোষণ বাছাই করা হয় এবং প্রতিনিধি এমন ক্রিয়া বাছাই করে যাতে সবচেয়ে দীর্ঘস্থায়ী ক্রিয়া বিদ্যমান (অন্য ক্রিয়ার থেকে এটিকে যখন তখন থামতে পারে না)। আবার, সম্ভাবনা এর ভিত্তিতে শোষ্ণ বাছাই করা হয় ও ক্রিয়া বাছাই হয় পুরোপুরিভাবে দৈবচয়িতভাবে। হল সাধারণত একটি স্থির বিষয়, এটি তালিকার ভিত্তিতে পরিবর্তন করা যেতে পারে (প্রতিনিধিকে কম অন্বেষণ করার জন্য) অথবা হিউরিস্টিকসের ভিত্তিতে আত্মীকরণ করা যেতে পারে।[৬]

কন্ট্রোল শিখনের অ্যালগরিদম[সম্পাদনা]

শোষণের বিষয়কেবালাদা রেখে যদি কোন অবস্থা পর্যবেক্ষণ করা হয় (পরে তথ্য পাওয়া যায়), তবে সমস্যাটি পূর্ব অভিজ্ঞতা বিবেচনা করে ভালো পদক্ষেপ বাছাই করে থাকে।

অনুমানকরণের শর্ত[সম্পাদনা]

নীতি[সম্পাদনা]

প্রতিনিধির পদক্ষেপ বা ক্রিয়া বাছাউ ম্যাপে "নীতি" হিসেবে অভিহিত করা হয়:

এই নীতি ম্যাপ পদক্ষেপ গ্রহণের সম্ভাবনা action প্রদান করে, যখন অবস্থা ।[৭]:৬১ এখানে অসম্ভবায়িত নীতিও বিদ্যমান।

অবস্থা মানীয় ফাংশন[সম্পাদনা]

মান ফাংশন কে "প্রত্যাশী আগমন" বলে অভিহিত করা যখন শুরুর অবস্থা , যেমন , এবং সঠিকভাবে নীতি মেনে চলে। এরপর, এর মাধ্যমে মান ফাংশন নির্দিষ্ট অবস্থায় এটি "কত ভাল" তা নির্ণয় করে।[৭]:৬০

যখন সাধারণ চলক আগমন বোঝায় এবং একে ভবিষ্যত হ্রাসকৃত উপায়ন বলে অভিহিত করা হয়।[স্পষ্টকরণ প্রয়োজন]

এখামে হল উপায়ন , ধাপের মান যেখানে হ্রাসকৃত।[স্পষ্টকরণ প্রয়োজন].

অ্যালগরিদমকে সর্বোচ্চ প্রত্যাশিত আগমন পাওয়ার পদ্ধতি বের করতে হবে। এমডিপির তত্ত্ব অনুসারে এটা জানা যায় যে, সাধারণ অবস্থায় হ্রাস না ঘটলে অনুসন্ধান একটি গুচ্ছে থেমে যায় যার সাথে "স্থির" নীতির সম্পর্ক বিদ্যমান। একটি পদ্ধতি স্থির হিসেবে অভিহিত হবে যদি এটি পর্যবেক্ষণের পর্যবেক্ষণকৃত শেষ অবস্থার ওপর ভিত্তি করে চলে। এই অনুসন্ধান নির্ণয় করা যায় এমন স্থির নীতির ওপর চলতে পারে। নির্ণয় করা যায় এমন স্থিত নীতি সঠিকভানে বর্তমান অবস্থার ভিত্তিতে পদক্ষেপ গ্রহণ করে থাকে। যদি এমন পদ্ধতি একগুচ্ছ পদক্ষেপ চিত্রায়নের মাধ্যমে পাওয়া যায়, তখন এই পদ্ধতিগুলো এই চিত্রায়ন থেকে আলাদা করা যায় যেখানে সাধারণ অবস্থা অক্ষুণ্ণ থাকে।

রূঢ় বল[সম্পাদনা]

রূঢ় বল মূলত দুইটি পদ্ধতির ওপর ভিত্তি করে চলে থাকে:

- প্রত্যেক সম্ভাব্য নীতি নমুনা একে অনুসরণ করে এসে থাকে

- এমন পদ্ধতি বাছাই করতে হবে যেখানে সর্বোচ্চ প্রত্যাশিত আগমন পাওয়া যায়।

এই ধরনের একটি সমস্যার নীতির সংখ্যা অনেক এমনকি অসংখ্যও হতে পারে। আরেকটি বিষয় গল, আগমনের পার্থক্য অনেক বেশি হতে পারে। এটির প্রয়োজন অনেক নমুনা যার দরুন প্রত্যেক নীতির আগমন যাচাই করা যায়।

এই ধরনের সমস্যার উন্নয়ন হতে পারে কাঠামোকে ভিত্তি করে যদি আমরা কিছু কাঠামো বিবেচনা করি ও নমুনাকে নীতির ওপর ভিত্তি করে অনুমিত ফলাফলের ওপর প্রভাব বিস্তার করতে দেই। এটি অর্জনের দুটি মূল পদ্ধতি হল মান ফাংশন আন্দাজকরণ ও সরাসরি নীতি অনুসন্ধান।

মান ফাংশন[সম্পাদনা]

মান ফাংশিন কিছু নীতির ওপর ভিত্তি করে একটি নীতি বাছাই করে থাকে (সাধারণত বর্তমান চলমান নীতি ও অনুমিত বাইরের নীতির মধ্যে) যেখানে আগমনের প্রতি গুরুত্ব দেওয়া হয়।

এই প্রক্রিয়া এমডিপির তত্ত্বেও ওপর ভিত্তি করে চলে থাকে, যেখানে পূর্বের অবস্থার থেকে শক্তিশালী অবস্থার ওপর ভিত্তিতে অনুমানকরণ চলে থাকে। একটি পদ্ধতিকে অনুমিত বলা যাবে যদি এটি অর্জন করে সর্বোচ্চ অনুমিত আগমন যেকোন প্রাথমিক অবস্থার জন্য (উদাহরণস্বরূপ, প্রারম্ভিক বিপণন এই সংজ্ঞার কোন প্রভাব ফেলে না। আবার, একটি অনুমিত নীতি সবসময় স্থির নীতির মাঝে পাওয়া যাবে।

সাধারণ অবস্থায় আন্দাজকরণের ক্ষেত্রে নীতির মানকে ধরে

এখানে হল এমন আগমন যার সাথে যুক্ত যা পাওয়া যায় প্রাথমিক অবস্থা থেকে। এখানে, কে এর সম্ভাব্য সর্বোচ্চ মান ধরা হয় ও এখানে পরিবর্তিত হতে পারে,

এই মানগুলো অর্জনকারী একটি নীতিকে পুরোপুরিভাবে প্রত্যেক অবস্থার জন্য "অনুমিত নীতি" হয়। পুরোপুরিভাবে, এই ধারার ওপর ভিত্তি করে ধরলে কোনো অনুমিত নীতি প্রত্যাশিত আগমন , যখন , যখন হল একটি অবস্থা যা দৈবচয়নের মাধ্যমে থেকে পাওয়া যায় ও [স্পষ্টকরণ প্রয়োজন] হল বিপণন, এর ওপর করেও তাকে অনুমিত নীতি বলে অভিহিত করা যায়।

যদিও অবস্থাভিত্তিক মান অনুমানের ভিত্তিতে বের করা হলেও এটি পদক্ষেপ মানের ক্ষেত্রেও গুরুত্বপূর্ণ ভূমিকা পালন করে। প্রদত্ত অবস্থা , পদক্ষেপ নীতি , জোড় মান যখন তা এর অধীন, এর মাধ্যমে বলা যায়,

যেখানে হল দৈবচয়ন আগমন যা প্রথমে নেওয়া পদক্ষেপ এর সাথে যুক্ত (যা অবস্থা ও তারপর এর ওপর ভিত্তি করে নেওয়া হয়েছিল)।

এমডিপির তত্ত্বে বলা হয়েছে যে, যদি অনুমিত নীতি হয় তবে আমাদের অনুমানের ভিত্তিতে (অনুমিত পদক্ষেপের মাধ্যমে) কাজ করতে হবে ও থেকে পদক্ষেপ গ্রহণ করতে হবে যখন প্রত্যেক অবস্থার সর্বোচ্চ মান । এই ধরনের অনুমিত নীতির () পদক্ষেপ মান ফাংশনকে "অনুমিত পদক্ষেপ মান-ফাংশন" বলা হয় এবং একে দিতে বোঝানো হয়। আসলে, অনুমিত পদক্ষেপ মান ফাংশন কীভাবে পদক্ষেপ নিতে হবে সে সম্পর্কে জ্ঞানদান করে থাকে।

এমডিপির পুরো জ্ঞান বিবেচনা করলে, পদক্ষেপ মান ফাংশন বের করার দুই পদ্ধতি হল মান পুনরাবৃত্তি ও নীতি পুনরাবৃত্তি। দুটি অ্যালগরিদমই () ধারার ফাংশন বের করে থাকে যা এর সাথে একসাথে মিলিত হয়। এই ধরনের ফাংশন বের করার মাধ্যমে গোটা অবস্থায় আগমনের পরিমাণ বের করা যায়, যা সব ব্যবস্থার জন্য প্রযোজ্য না হলেও ক্ষুদ্র (নির্দিষ্ট) এমডিপির জন্য প্রযোজ্য। বলবর্ধনমূলক শিখন পদ্ধতিতে, প্রত্যাশাব্বের করা হয় নমুনা থেকে পাওয়া মান গড় করার মাধ্যমে ও এখানে অনুমিত ফাংশন পদ্ধতি ব্যবহার করা হয় যার দরুন বৃহৎ অবস্থার মান ফাংশনের সাথে তা তাল মিলিয়ে চলতে পারে।

মন্টি কার্লো পদ্ধতি[সম্পাদনা]

মন্টি কার্লো পদ্ধতি এমন অ্যালগরিদমে ব্যবহার করা যাব্ব, যেখানে নকল পুনরাবৃত্তীয় নীতির ওপর চলে। নীতির পুনরাবৃত্তির দুটি ধাপ বিদ্যমান, নীতি মূল্যায়ন ও নীতি উন্নয়ন।

পদক্ষেপ মূল্যায়ন নীতিতে মন্টি কার্লো পদ্ধতি কাজে লাগে। এই পদক্ষেপে, প্রদত্ত স্থির, নির্ণেয় নীতি , ফাংশন মান বের করার লক্ষ্য (অথবা এদের মাঝে একটি ভাল অনুমান ) সব অবস্থা পদক্ষেপ জোড় এর সাথে। সহজভাবে মনে করা যায় যে, এমডিপি নির্দিষ্ট যা পদক্ষেপ মানের জন্য পর্যপ্ত জায়গা রাখতে পারে যার মাধ্যমে এটি সংরক্ষণ করা যায় যেখানে সমস্যাগুলো পর্বভিত্তিক হয় ও একটি পর্বের একটি আরেকটি নতুনের সূচনা ঘটে যা আসে দৈবচয়নের ভিত্তিতে। এরপর, প্রদত্ত অবস্থা পদক্ষেপের অনুমিত মান বের করা যায় নমুনার মানের গড়ের মাধ্যমে যা আসে একটি সময়ের থেকে। প্রদত্ত পর্যাপ্ত সময় থেকে পদ্ধতিতে যথাযথ অনুমিত মান আসে পদক্ষেপ মান ফাংশনf থেকে। এর মাধ্যমে নীতি পর্যালোচনা ধাপের বর্ণনা শেষ হয়।

নীতি উন্নয়ন ধাপে পরবর্তী নীতি পাওয়া যায় "রূঢ়" নীতি বের করার মাধ্যমে যা এর সাথে সম্পর্কিত: প্রদত্ত অবস্থা , এ নতুন নীতি একটি পদক্ষেপ নিয়ে আসে যা এর মান বৃদ্ধি করে। বাস্তবিক অর্থে, নিষ্ক্রিয় পর্যালোচনা নিষ্ক্রিয় রাখতে পারে সর্বোচ্চ পদক্ষেপ নির্ণয় করা পদ্ধতিকে যখন এর তা প্রয়োজন হয়।

এই প্রক্রিয়ার সমস্যাগুলো হল:

- এই পদ্ধতি একটি অর্ধ অনুমিত নীতি পর্যালোচনার ক্ষেত্রে অনেক সময় ব্যয় করতে পারে।

- এটি অদক্ষভাবে নমুনা ব্যবহার করে যার দরুন সমাধানের একটি বিশাল পথ বিকশিত হয় যা কেবল "একটি" অবস্থা পদক্ষেপ জোড় নিয়ে কাজ করে।I

- যখন এই বিশাল পথে আগমনের মানের বড় পার্থক্য দেখা যায়, তখন একই বিন্দুতে মিলিত হবার ঘটনা দীর্ঘায়িত হয়।

- এটি শুধু পর্বভিত্তিক সমস্যা নিয়ে কাজ করে;

- এটি ছোট, নির্দিষ্ট এমডিপি নিয়ে কাজ করে।

অস্থায়ী পার্থক্য পদ্ধতি[সম্পাদনা]

প্রথম সমস্যা কিছু বা সব অবস্থায় পদ্ধতিকে নীতি পরিবর্তন করার অনুমতি প্রদানের মাধ্যমে সমাধান করা যায়। এক্ষেত্রে মানগুলোর স্থায়ী হবার পূর্বে কাজ করা হয়। এটি খুবই সমস্যার বিষয় কেননা এটি একই বিন্দুতে মিলিত হওয়া প্রতিরোধ করতে পারে। বর্তমানে অধিকাংশ অ্যালগরিদম সাধারণ নীতি পুনরাবৃত্তি করার মাধ্যমে কাজ করে থাকে। অনেক "অভিনেতা সমালোচক" পদ্ধতি এই শ্রেণীর আওতাভুক্ত।

এর দ্বিতীয় ইস্যুটি আবক্র পথকে যেকোন অবস্থা-পদক্ষেপ জোড়ে অবদান রাখার অনুমতি প্রদানের মাধ্যমে সঠিক করা যেতে পারে। এটি তৃতীয় সমস্যার কয়েকটি ক্ষেত্রে সাহায্য করতে পারে। এটি ভালো সমাধানে অবদান রাখতে পারে যখন আগমনের ক্ষেত্রে অনেক পার্থক্য দেখা যায় যখন তা সাটনের "অস্থায়ী পার্থক্য" (টিডি) এর মাঝে পড়ে, যা পুনরাবৃত্ত বেলম্যান সমীকরণের ভিত্তিতে গড়ে উঠেছে।[৮][৯] টিডি পদ্ধতির মান নির্ণয় বাড়তে পারে যখন রূপান্তর শেষ হবার পর স্মৃতির পরিবর্তন ঘটে ও রূপান্তরকে বিবেচনা না করা হয় অথবা দলে পরিণত হতে পারে (যখন দলবদ্ধভাবে রূপান্তর করা হয় এবং অনুমান করা হয় দলের ভিত্তিতে)। দলবদ্ধ পদ্ধতি যেমব ন্যূনতম বর্গ অস্থায়ী পার্থক্য পদ্ধতি,[১০] তুলনামূলক ভালোভাবে নমুনার তথ্য ব্যবহার করতে পারে। অপরদিকে বেড়ে ওঠা পদ্ধতি হল একমাত্র পছন্দ হয়ে দাঁড়ায় যখন দল প্রক্রিয়া বিশাল গাণিতিক প্রক্রিয়া ও স্মৃতির জটিলতার দরুন অচল হয়ে দাঁড়ায়। কিছু পদ্ধতি এই দুইটি পথের সমন্বয়ে চলে থাকে। অস্থায়ী পার্থক্যকে ভিত্তি করে চলা পদ্ধতি চতুর্থ ইস্যুরও সমাধান করতে সক্ষম হয়।

পঞ্চম ইস্যুর ক্ষেত্রে "ফাংশন অনুমিত পদ্ধতি" ব্যবহার করা হয়। "রৈখিক ফাংশন" চিত্রায়নের মাধ্যমে যাত্রা শুরু করে যা প্রত্যেক অবস্থা-পদক্ষেপ জোড়ার জন্য একটি নির্দিষ্ট মাত্রার ভেক্টর। এরপর অবস্থা পদক্ষেপ জোড়ার পদক্ষেপ মান পাওয়া যায় রৈখিকভাবে যুক্ত উপদান ও কিছু "ওজন" এর মাধ্যমে :

এই অ্যালগরিদম সাম্যাবস্থায় আনে। এটি একেকটি অবস্থা পদক্ষেপ জোড়ার মান বিবেচনা না করে এই কাজ করে থাকে। অবৈষয়িক পরিসংখ্যান থেকে পাওয়া সিদ্ধান্ত থেকে পদ্ধতি অনুসন্ধান করা যেতে পারে যাদের তাদের নিজেদের অভ্যন্তরীণ অবস্থা গঠনে কাজে লেগে থাকতে দেখা যেতে পারে।

মানের পুনরাবৃত্তি গোড়া থেকেও ব্যবহৃত হতে পারে। এক্ষেত্রে কিউ-শিক্ষাগ্রহণ অ্যালগরিদমকে এর অনেক চলকের দিকে গুরুত্ব দিয়ে কাজ করা হয়।[১১]

এই পদক্ষেপ-মান ব্যবহারের সমস্যা হল এক্ষেত্রে তাদের পুরোপুরিভাবে যথাযথ অনুমান লাগতে পারে প্রতিদ্বন্দ্বী পদক্ষেপ মানের ক্ষেত্রে যার মান নের করা কষ্টসাধ্য হতে পারে যখন আগমনের মান বেশি হয়ে থাকে। এই সমস্যা অস্থায়ী পার্থক্য পদ্ধতির কিছু প্রয়োগের মাধ্যমে মেটানো যায়। এই কথিত সামঞ্জস্যপূর্ণ ফাংশন অনুমান প্রক্রিয়ার মাধ্যকে সাধারণত্ব ও দক্ষতার সাথে আপোসে যেতে হয়। এই পদ্ধতির আরেকটা সমস্যা হল টিডি পুনরাবৃত্ত বেলম্যান সমীকরণের ওপর নির্ভর করে থাকে। অধিকাংশ টিডি পদ্ধতিতে কথিত বিষয় আসে যা বারবার মন্টি কার্লো পদ্ধতিতে হস্তক্ষেপ করে যা বেলম্যান সমীকরণ নির্ভরশীল নয় এবং মৌলিক টিডি পদ্ধতিগুলো মূলত বেলম্যান সমীকরণকে ভিত্তি করে চলে। এটি এই ইস্যু সমাধানে গুরুত্বপূর্ণ ভূমিকা রাখতে পারে।

সরাসরি নীতি অনুসন্ধান[সম্পাদনা]

একটি বিকল্প পদ্ধতি হল নীতির মাঝে বা এর কিছু অংশে সরাসরি অনুসন্ধান চালানো, এত দরুন সমস্যা সম্ভাবনার সূত্র দ্বারা নিয়ন্ত্রিত ঘটনায় পরিণত হয়। এই প্রক্রিয়ার দুইটি পদ্ধতি হল: গ্রাডিয়ান্টভিত্তিক পদ্ধতি ও গ্রাডিয়ান্টহীন পদ্ধতি।

গ্রাডিয়ান্ট ভিত্তিক পদ্ধতি (নীতি গ্রাডিয়ান্ট পদ্ধতি) যাত্রা শুরু করে নির্দিষ্ট মাত্রা (বিষয়) জায়গায় নীতি চিত্রায়নের মাধ্যমে: প্রদত্ত বিষয়ের ভেক্টর , মনে করি নির্দেয়াস করে এর সাথে নীতির সম্পর্ক। তাহলে ফলাফল ফাংশন দাঁড়ায়,

ধীর অবস্থায় প্যারামিটার ভেক্টর এর সাহায্যে ব্যবকলন করা যেতে পারে। যদি এর গ্রাডিয়ান্ট জানা যায়, তবে কেউ গ্রাডিয়ান্টের ঊর্ধ্বগতি দেখতে পারবে। যদি গ্রাডিয়ান্টের বিশ্লেষিত অভিব্যক্তি পাওয়া না যায়, তবে একটি এলোমেলো অনুমান পাওয়া যেতে পারে। এই ধরনের অনুমান বিভিন্ন ভাবে তৈরি করা যেতে পারে। যেমন, উইলিয়ামের রিইনফোর্স পদ্ধতি[১২] (এটি অনুকার ভিত্তিক অনুমানের ক্ষেত্রে একই রকম অনুপাত প্রক্রিয়া নামে পরিচিত)।[১৩] নীতি অনুসন্ধান পদ্ধতি রোবোটিক্সের ক্ষেত্রে ব্যবহার করা যেতে পারে।[১৪] অনেক নীতি অনুসন্ধান পদ্ধতি স্থানীয় দর্শনে আটকে পড়তে পারে কেননা, এটি স্থানীয় অনুসন্ধানের ভিত্তিতে চলে।

পদ্ধতির অধিকাংশই গ্রাডিয়ান্ট তথ্যের ওপর ভিত্তি করে চলে না। এদের মাঝে অনুকারী কোমলায়ন, বিপরীত এন্ট্রপি পদ্ধতি বা বৈপ্লবিক গণনার পদ্ধতিগুলোর নাম করা যায়। অনেক গ্রাডিয়ান্টহীন পদ্ধতি পর্যবেক্ষণে পার্থক্যের নজির দেখা যায় না।

প্রদত্ত এলোমেলো তথ্যের ক্ষেত্রে নীতি অনুসন্ধান পদ্ধতি একই বিন্দুতে মিলিত হতে পারে। উদাহরণস্বরূপ, এর নজির পর্বভিত্তিক সমস্যায়l দেখা যেতে পারে যখন সমাধানের পথ বিশাল ও এক আগমনের সাথে আরেক আগমনের পার্থক্য অনেক বেশি। মান-ফাংশন ভিত্তিক পদ্ধতিগুলো অস্থায়ী পার্থক্যকে ভিত্তি করে চলে যা এক্ষেত্রে গুরুত্বপূর্ণ ভূমিকা রাখতে পারে। ইদানীং এসব ক্ষেত্রে সমাধানের জন্য "অভিনেতা–সমালোচক পদ্ধতি" ব্যবহার করতে বলা হয়। এই পদ্ধতি এক্ষেত্রে ভালোভাবে সমস্যার সমাধান করতে সক্ষম হয়েছে।[১৫]

তত্ত্ব[সম্পাদনা]

অ্যালগরিদম অসীম ও সসীম ব্যবহার ভালোভাবে বোঝা যায়। অনুসন্ধান ইস্যুর অ্যালগরিদম যাতে প্রমাণিত ভাল অনলাইন পারফরমেন্স বিদ্যমান তা জানা যায়।

বিশাল এমডিপিগুলোতে দক্ষ অনুসন্ধান মূলত সম্ভব হয় না (ব্যান্ডিত সমস্যা এ বিষয়ে ব্যতিক্রম)।[স্পষ্টকরণ প্রয়োজন] যদিও সসীম সময়ের ফলাগল অনেক অ্যালগরিদমেত সাথে যুক্ত থাকলেও তারা দৃঢ়ভাবে যুক্ত থাকবে না এমন প্রত্যাশা করা হয় এবং এজন্য অনেক কাজের দরকার হয় যার দরুন সহজে এর সুফল কুফল বুঝতে কষ্ট হয়,।

বর্ধিষ্ণু অ্যালগরিদমের ক্ষেত্রে অসীমে একই বিন্দুতে মিলিত হবার বিষয় দাঁড় করানো হয়। অস্থায়ী পার্থক্য ভিত্তিক অ্যালগরিদনে এই একই বিন্দুতে মিলিত হবার ক্ষেত্রে অনেক শর্ত লাহে যা পূর্বে খুব সহজেই অর্জিত হত (উদাহরণস্বরূপ, মধ্যস্থতাকারী মসৃণ ফাংশন অনুমান ব্যবহার করা হলে)।

গবেষণা[সম্পাদনা]

এর গবেষণা ক্ষেত্রের অন্তর্ভুক্ত হল

- আত্মীকৃত পদ্ধতি যা অল্প (বা শূন্য) বিষয় নিয়ে অনেক শর্তের অধীনে কাজ করে থাকে

- বিশাল এমডিপিতে অনুসন্ধান সমস্যার পরিচিতি

- বৃহদাকারের গবেষণামূলজ অভিব্যক্তি

- আংশিক তথ্যের অধীনে শেখা ও কাজ করা (উদাহরণস্বরূপ প্রত্যাশিত অবস্থা উপস্থাপন)

- পরিমিত ও প্রাচীন বলবর্ধনমূলক শিখন

- বিদ্যমান মান ফাংশনের উন্নতি ও নীতি অনুসন্ধান পদ্ধতি

- যেসব অ্যালগরিদম বিশাল বা চলমান পদক্ষেপ স্থান নিয়ে কাজ করে

- স্থানান্তর শিক্ষাগ্রহণ

- আজীবন শিক্ষাগ্রহণ

- দক্ষ নমুনা ভিত্তিক পরিকল্পনা (যেমন, মন্টি কার্লো অনুসন্ধান ভিত্তিক)।

- সফটওয়্যার প্রকল্পে ভুল নির্ণয়[১৬]

একাধিক প্রতিনিধিভিত্তিক বা বিন্যস্ত বলবর্ধনমূলক শিখন হল বর্ধিষ্ণু বিষয়। এর প্রয়োগও বাড়ছে।[১৭]

- অভিনেতা–সমালোচক বলবর্ধনমূলক শিখন

বলবর্ধনমূলক শিখন অ্যালগরিদম যেমন টিডি শিখন নিয়ে মস্তিষ্কে ডোপামিন-ভিত্তিক শিক্ষাগ্রহণ বিষয়ে গবেষণা করা হচ্ছে। এই মডেলে সাবস্টানশিয়া নিগ্রা থেলে বাসাল গ্যাংলিয়া থেকে ডোপামিনভিত্তিক অভিক্ষেপ অনুমান ভুলে অবদান রাখে। বলবর্ধনমূলক শিক্ষাগ্রহণ মানব দক্ষতা শিক্ষাগ্রহণের মডেল হিসেবে ব্যবহৃত হচ্ছে, এটি বিশেষত দক্ষতা অর্জনের অন্তর্নিহিত ও প্রকাশিত শিক্ষাগ্রহণের ক্ষেত্রে অবদান রাখে (এটি সম্পর্কিত প্রকাশনা ১৯৯৫–১৯৯৬) এ প্রথম প্রকাশিত হয়)।[১৮]

বলবর্ধনমূলক শিখনের অ্যালগরিদমের মাঝে তুলনা[সম্পাদনা]

| অ্যালগরিদম | বর্ণনা | মডেল | নীতি | পদক্ষেপ স্থান | অবস্থা স্থান | পরিচালক |

|---|---|---|---|---|---|---|

| মন্টি কার্লো | সবসময় মন্টি কার্লোতে গমন | মডেলহীন | নীতিবহির্ভূত | বিচ্ছিন্ন | বিচ্ছিন্ন | নমুনা দ্বারা |

| কিউ শিক্ষাগ্রহণ | অবস্থা–পদক্ষেপ–

উপায়ন–অবস্থা |

মডেলহীন | নীতিবহির্ভূত | বিচ্ছিন্ন | বিচ্ছিন্ন | কিউ-মান |

| সারসা | অবস্থা–পদক্ষেপ–

উপায়ন–অবস্থা–পদক্ষেপ |

মডেলহীন | নীতির অধীনে | বিচ্ছিন্ন | বিচ্ছিন্ন | কিউ-মান |

| কিউ শিক্ষাগ্রহণ ল্যাম্বডা | যোগ্য খসড়ায় অবস্থা–পদক্ষেপ–

উপায়ন–অবস্থা |

মডেলহীন | নীতি বহির্ভূত | বিচ্ছিন্ন | বিচ্ছিন্ন | কিউ-মান |

| সারসা ল্যাম্বডা | যোগ্য খসড়ায় অবস্থা–পদক্ষেপ–

উপায়ন–অবস্থা–পদক্ষেপ |

মডেলহীন | নীতির অধীন | বিচ্ছিন্ন | বিচ্ছিন্ন | কিউ-মান |

| ডি কিউ এন | গভীর কিউ নেটওয়ার্ক | মডেলহীন | নীতিবহির্ভূত | বিচ্ছিন্ন | চলমান | কিউ-মান |

| ডিডিপিজি | গভীর নির্ণেয় নীতি গ্রাডিয়ান্ট | মডেলহীন | নীতিবহির্ভূত | চলমান | চলমান | কিউ-মান |

| এ৩সি | অমিল উন্নত অভিনেতা সমালোচক অ্যালগরিদম | মডেলহীন | নীতির অধীন | চলমান | চলমান | উন্নত |

| এনএএফ | সাধারণ উন্নত ফাংশনের সাহায্যে কিউ শিখন | মডেলহীন | নীতিবহির্ভূত | চলমান | চলমান | উন্নত |

| টিআরপিও | বিশ্বস্ত অঞ্চল নীতি আন্দাজকরণ | মডেলহীন | নীতির অধীন | চলমান | চলমান | উন্নত |

| পিপিও | অনুমিত নীতি আন্দাজকরণ | মডেলহীন | নীতির অধীন | চলমান | চলমান | উন্নত |

| টিডি৩ | জোড়া বিলম্বিত গভীর নির্ণেয় নীতি গ্রাডিয়ান্ট | মডেলহীন | নীতি বহির্ভূত | চলমান | চলমান | কিউ-মান |

| এসএসি | কোমল অভিনেতা–সমালোচক | মডেলহীন | নীতিবহির্ভূত | চলমান | চলমান | উন্নত |

গভীর বলবর্ধনমূলক শিখন[সম্পাদনা]

এই পদ্ধতিতে বলবর্ধনমূলক শিখনকে বাড়ানো হয় হয় এক্ষেত্রে গভীর নিউরাল নেটওয়ার্কের সাহায্য নেওয়া হয় এবং এখানে স্পষ্টভাবে অবস্থার সাজানো জায়গার সাহায্য ছাড়া কাজ করা হয়।[১৯] গুগল ডিপমাইন্ডের সাহায্যে আটারি খেলে শিক্ষাগ্রহণ গভীর বলবর্ধনমূলক শিক্ষাগ্রহণ বা প্রান্ত থেকে প্রান্ত বলবর্ধনমূলক শিক্ষাগ্রহণের প্রতি আগ্রহ বৃদ্ধি করেছে।[২০]

বিপরীত বলবর্ধনমূলক শিক্ষাগ্রহণ[সম্পাদনা]

বিপরীত বলবর্ধনমূলক শিখনে (আইআরএল) কোনো উপায়ন ফাংশান দেওয়া হয় না। এর পরিবর্তে, এক দক্ষ ব্যক্তির পর্যবেক্ষণ থেকে পাওয়া বৈশিষ্ট্য থেকে উপায়ন ফাংশন চালানো হয়। এই চিন্তা পর্যবেক্ষণকৃত বৈশিষ্ট্যের অনুকারী, যেগুলো অনুমিত হয় বা অনুমানের কাছাকাছি থাকে।[২১]

নবিশ শিক্ষাগ্রহণ[সম্পাদনা]

নবিশ শিক্ষাগ্রহণে একজন দক্ষ ব্যক্তি লক্ষ্য বৈশিষ্ট্য সম্পর্কে আলোচনা করেন। এই পদ্ধতিতে পর্যবেক্ষণের মাধ্যমে নীতি পুনরুদ্ধারে চেষ্টা করা হয়।

তথ্যসূত্র[সম্পাদনা]

- ↑ Kaelbling, Leslie P.; Littman, Michael L.; Moore, Andrew W. (১৯৯৬)। "Reinforcement Learning: A Survey"। Journal of Artificial Intelligence Research। 4: 237–285। arXiv:cs/9605103

। ডিওআই:10.1613/jair.301। ২০০১-১১-২০ তারিখে মূল থেকে আর্কাইভ করা।

। ডিওআই:10.1613/jair.301। ২০০১-১১-২০ তারিখে মূল থেকে আর্কাইভ করা।

- ↑ van Otterlo, M.; Wiering, M. (২০১২)। Reinforcement learning and markov decision processes। Reinforcement Learning। Adaptation, Learning, and Optimization। 12। পৃষ্ঠা 3–42। আইএসবিএন 978-3-642-27644-6। ডিওআই:10.1007/978-3-642-27645-3_1।

- ↑ Sutton Barto, Chapter 11।

- ↑ Gosavi, Abhijit (২০০৩)। Simulation-based Optimization: Parametric Optimization Techniques and Reinforcement। Operations Research/Computer Science Interfaces Series। Springer। আইএসবিএন 978-1-4020-7454-7। ১৫ জুন ২০১২ তারিখে মূল থেকে আর্কাইভ করা। সংগ্রহের তারিখ ৩১ আগস্ট ২০১৯।

- ↑ Burnetas, Apostolos N.; Katehakis, Michael N. (১৯৯৭), "Optimal adaptive policies for Markov Decision Processes", Mathematics of Operations Research, 22: 222––255

- ↑ Tokic, Michel; Palm, Günther (২০১১), "Value-Difference Based Exploration: Adaptive Control Between Epsilon-Greedy and Softmax" (পিডিএফ), KI 2011: Advances in Artificial Intelligence, Lecture Notes in Computer Science, 7006, Springer, পৃষ্ঠা 335–346, আইএসবিএন 978-3-642-24455-1, ২৩ নভেম্বর ২০১৮ তারিখে মূল (পিডিএফ) থেকে আর্কাইভ করা, সংগ্রহের তারিখ ৩১ আগস্ট ২০১৯

- ↑ ক খ Reinforcement learning: An introduction (পিডিএফ)। ১২ জুলাই ২০১৭ তারিখে মূল (পিডিএফ) থেকে আর্কাইভ করা। সংগ্রহের তারিখ ৩১ আগস্ট ২০১৯।

- ↑ Sutton, Richard S. (১৯৮৪)। Temporal Credit Assignment in Reinforcement Learning (গবেষণাপত্র)। University of Massachusetts, Amherst, MA। ৩০ মার্চ ২০১৭ তারিখে মূল থেকে আর্কাইভ করা। সংগ্রহের তারিখ ৩১ আগস্ট ২০১৯।

- ↑ Sutton ও Barto 1998, §6. Temporal-Difference Learning।

- ↑ Bradtke, Steven J.; Barto, Andrew G. (১৯৯৬)। "Learning to predict by the method of temporal differences"। Machine Learning। 22: 33–57। ডিওআই:10.1023/A:1018056104778। সাইট সিয়ারX 10.1.1.143.857

।

।

- ↑ Watkins, Christopher J.C.H. (১৯৮৯)। Learning from Delayed Rewards (পিডিএফ) (গবেষণাপত্র)। King’s College, Cambridge, UK।

- ↑ Williams, Ronald J. (১৯৮৭)। "A class of gradient-estimating algorithms for reinforcement learning in neural networks"। Proceedings of the IEEE First International Conference on Neural Networks। সাইট সিয়ারX 10.1.1.129.8871

।

।

- ↑ Peters, Jan; Vijayakumar, Sethu; Schaal, Stefan (২০০৩)। "Reinforcement Learning for Humanoid Robotics" (পিডিএফ)। IEEE-RAS International Conference on Humanoid Robots। ১২ মে ২০১৩ তারিখে মূল (পিডিএফ) থেকে আর্কাইভ করা। সংগ্রহের তারিখ ৩১ আগস্ট ২০১৯।

- ↑ Deisenroth, Marc Peter; Neumann, Gerhard; Peters, Jan (২০১৩)। A Survey on Policy Search for Robotics। Foundations and Trends in Robotics। 2। NOW Publishers। পৃষ্ঠা 1–142। hdl:10044/1/12051।

- ↑ Juliani, Arthur (২০১৬-১২-১৭)। "Simple Reinforcement Learning with Tensorflow Part 8: Asynchronous Actor-Critic Agents (A3C)"। Medium। সংগ্রহের তারিখ ২০১৮-০২-২২।

- ↑ "On the Use of Reinforcement Learning for Testing Game Mechanics : ACM - Computers in Entertainment"। cie.acm.org (ইংরেজি ভাষায়)। সংগ্রহের তারিখ ২০১৮-১১-২৭।

- ↑ "Reinforcement Learning / Successes of Reinforcement Learning"। umichrl.pbworks.com। সংগ্রহের তারিখ ২০১৭-০৮-০৬।

- ↑ "সংরক্ষণাগারভুক্ত অনুলিপি"। ২০১৭-০৪-২৬ তারিখে মূল থেকে আর্কাইভ করা। সংগ্রহের তারিখ ২০১৯-০৮-৩১।

- ↑ Francois-Lavet, Vincent; ও অন্যান্য (২০১৮)। "An Introduction to Deep Reinforcement Learning"। Foundations and Trends in Machine Learning। 11 (3–4): 219–354। arXiv:1811.12560

। ডিওআই:10.1561/2200000071।

। ডিওআই:10.1561/2200000071।

- ↑ Mnih, Volodymyr; ও অন্যান্য (২০১৫)। "Human-level control through deep reinforcement learning"। Nature। 518 (7540): 529–533। ডিওআই:10.1038/nature14236। পিএমআইডি 25719670। বিবকোড:2015Natur.518..529M।

- ↑ Ng, A. Y.; Russell, S. J. (২০০০)। "Algorithms for Inverse Reinforcement Learning" (পিডিএফ)। Proceeding ICML '00 Proceedings of the Seventeenth International Conference on Machine Learning। পৃষ্ঠা 663–670। আইএসবিএন 1-55860-707-2।

আরো পড়ুন[সম্পাদনা]

- Auer, Peter; Jaksch, Thomas; Ortner, Ronald (২০১০)। "Near-optimal regret bounds for reinforcement learning"। Journal of Machine Learning Research। 11: 1563–1600।

- Busoniu, Lucian; Babuska, Robert; De Schutter, Bart; Ernst, Damien (২০১০)। Reinforcement Learning and Dynamic Programming using Function Approximators। Taylor & Francis CRC Press। আইএসবিএন 978-1-4398-2108-4।

- François-Lavet, Vincent; Henderson, Peter; Islam, Riashat; Bellemare, Marc G.; Pineau, Joelle (২০১৮)। "An Introduction to Deep Reinforcement Learning"। Foundations and Trends in Machine Learning। 11 (3–4): 219–354। arXiv:1811.12560

। ডিওআই:10.1561/2200000071।

। ডিওআই:10.1561/2200000071। - Powell, Warren (২০০৭)। Approximate dynamic programming: solving the curses of dimensionality। Wiley-Interscience। আইএসবিএন 978-0-470-17155-4। ৩১ জুলাই ২০১৬ তারিখে মূল থেকে আর্কাইভ করা। সংগ্রহের তারিখ ৩১ আগস্ট ২০১৯।

- Sutton, Richard S.; Barto, Andrew G. (১৯৯৮)। Reinforcement Learning: An Introduction। MIT Press। আইএসবিএন 978-0-262-19398-6। ৩০ মার্চ ২০১৭ তারিখে মূল থেকে আর্কাইভ করা। সংগ্রহের তারিখ ৩১ আগস্ট ২০১৯।

- Sutton, Richard S. (১৯৮৮)। "Learning to predict by the method of temporal differences"। Machine Learning। 3: 9–44। ডিওআই:10.1007/BF00115009। ৩০ মার্চ ২০১৭ তারিখে মূল থেকে আর্কাইভ করা। সংগ্রহের তারিখ ৩১ আগস্ট ২০১৯।

- Szita, Istvan; Szepesvari, Csaba (২০১০)। "Model-based Reinforcement Learning with Nearly Tight Exploration Complexity Bounds" (পিডিএফ)। ICML 2010। Omnipress। পৃষ্ঠা 1031–1038। ২০১০-০৭-১৪ তারিখে মূল (পিডিএফ) থেকে আর্কাইভ করা।

বহিঃসংযোগ[সম্পাদনা]

- Reinforcement Learning Repository

- Reinforcement Learning and Artificial Intelligence (RLAI, Rich Sutton's lab at the University of Alberta)

- A Beginner's Guide to Deep Reinforcement Learning

- Autonomous Learning Laboratory (ALL, Andrew Barto's lab at the University of Massachusetts Amherst)

- Hybrid reinforcement learning

- Real-world reinforcement learning experiments at Delft University of Technology

- Stanford University Andrew Ng Lecture on Reinforcement Learning

- Dissecting Reinforcement Learning Series of blog post on RL with Python code

![{\displaystyle \pi :A\times S\rightarrow [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/53cdefaaea162af26e217b740b90f8f8c692a641)

![{\displaystyle V_{\pi }(s)=\operatorname {E} [R]=\operatorname {E} \left[\sum _{t=0}^{\infty }\gamma ^{t}r_{t}\mid s_{0}=s\right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bc1c166de6a87c9ea1462febcdcedad310ec15ef)

![{\displaystyle \gamma \in [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cbc65bc4fa0e25a8305259b234865def64ac1a8a)

![{\displaystyle V^{\pi }(s)=E[R\mid s,\pi ],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d8ff1cf02d3c0c16f1d0da9a204cf9e4d955c48c)

![{\displaystyle \rho ^{\pi }=E[V^{\pi }(S)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/607d2a3c3a3f369d464fb3fd4beb5c7a108ad690)

![{\displaystyle Q^{\pi }(s,a)=\operatorname {E} [R\mid s,a,\pi ],\,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/589b970c42fc5cd7b8a1c4859046d18e97046090)